تعرف على حالة غريبة من هلوسة الذكاء الاصطناعي

معدل انتشار الذكاء الاصطناعي يجعل المرء يعتقد أننا مستعدون لمثل هذا التعهد. أصبحت التطبيقات التي تعمل بالذكاء الاصطناعي معيارًا سريعًا إلى حد ما ، حتى لو بدأ معظم العالم الآن فقط في الاهتمام بالذكاء الاصطناعي على نطاق واسع ، بعد وصول ChatGPT. ولكن هناك مشكلة كبيرة في أنظمة الذكاء الاصطناعي لا يمكن تجاهلها – هلوسة الذكاء الاصطناعي أو الهلوسة الاصطناعية.

إذا سبق لك الانتباه إلى التفاصيل الدقيقة قبل استخدام روبوت محادثة AI ، فربما تكون قد صادفت الكلمات ، “الذكاء الاصطناعي عرضة للهلوسة.” نظرًا للزيادة الهائلة في استخدام الذكاء الاصطناعي ، فقد حان الوقت لتثقيف نفسك حول ماهية هذه الأشياء بالضبط.

ما هو هلوسة الذكاء الاصطناعي؟

تشير الهلوسة بالذكاء الاصطناعي ، بشكل عام ، إلى حقيقة قدمها الذكاء الاصطناعي بثقة ، على الرغم من عدم وجود مبرر لها في بيانات التدريب الخاصة به. عادة ما تكون نتيجة لحالات شاذة في نموذج الذكاء الاصطناعي.

تم أخذ القياس من الهلوسة التي يعاني منها البشر ، حيث يدرك البشر شيئًا غير موجود في البيئة الخارجية. في حين أن المصطلح قد لا يكون مناسبًا تمامًا ، إلا أنه غالبًا ما يستخدم كاستعارة لوصف الطبيعة غير المتوقعة أو السريالية لهذه المخرجات.

لكن يجب أن تتذكر أنه على الرغم من أن التشابه يمثل نقطة انطلاق جيدة للتعامل مع هلوسة الذكاء الاصطناعي ، إلا أن الظاهرتين تفصل بينهما أميال من الناحية الفنية. في تحول مثير للسخرية للأحداث ، حتى ChatGPT نفسها تجد أن القياس خاطئ. بتشريحه على المستوى الجزيئي ، يقول إنه نظرًا لأن نماذج لغة الذكاء الاصطناعي ليس لديها خبرة شخصية أو تصورات حسية ، فإنها لا تستطيع الهلوسة بالمعنى التقليدي للكلمة. وعليك عزيزي القارئ أن تفهم هذا الاختلاف المهم. علاوة على ذلك ، تقول ChatGPT أن استخدام مصطلح الهلوسة لوصف هذه الظاهرة يمكن أن يكون مربكًا لأنه قد يشير بشكل غير دقيق إلى مستوى من الخبرة الذاتية أو الخداع المتعمد.

بدلاً من ذلك ، يمكن وصف هلوسة الذكاء الاصطناعي بدقة أكبر بأنها أخطاء أو عدم دقة في استجابتها ، مما يجعل الاستجابة غير صحيحة أو مضللة. مع روبوتات المحادثة ، غالبًا ما يتم ملاحظتها عندما يصنع روبوت الدردشة بالذكاء الاصطناعي (أو يهذي) الحقائق ويقدمها على أنها يقين مطلق.

أمثلة على هلوسة الذكاء الاصطناعي

يمكن أن تحدث الهلوسة في العديد من تطبيقات الذكاء الاصطناعي ، مثل نماذج الرؤية الحاسوبية ، وليس فقط نماذج معالجة اللغة الطبيعية.

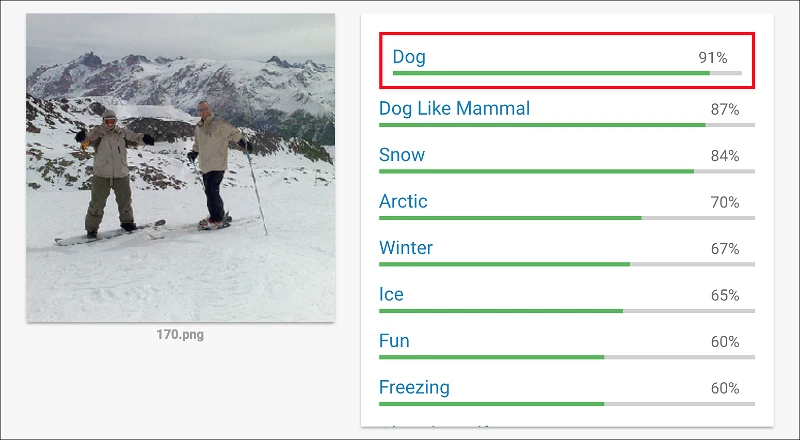

في رؤية الكمبيوتر ، على سبيل المثال ، قد ينتج عن نظام الذكاء الاصطناعي صورًا أو مقاطع فيديو هلوسة تشبه أشياء أو مشاهد حقيقية ولكنها تحتوي على تفاصيل غير منطقية أو مستحيلة. أو ، يمكن لنموذج الرؤية الحاسوبية أن يدرك الصورة كشيء آخر تمامًا. على سبيل المثال ، رأى نموذج Cloud Vision من Google صورة رجلين على زلاجات واقفين في الثلج صنعها Anish Athalye (طالب دراسات عليا في معهد ماساتشوستس للتكنولوجيا جزء من labsix ) وذكرها على أنها كلب بنسبة يقين 91٪.

ائتمانات: labsix. مجموعة أبحاث مستقلة للذكاء الاصطناعي

وبالمثل ، في معالجة اللغة الطبيعية ، قد ينتج نظام الذكاء الاصطناعي نصًا غير منطقي أو مشوه يشبه اللغة البشرية ولكن ليس له معنى متماسك أو حقائق تبدو قابلة للتصديق ولكنها غير صحيحة.

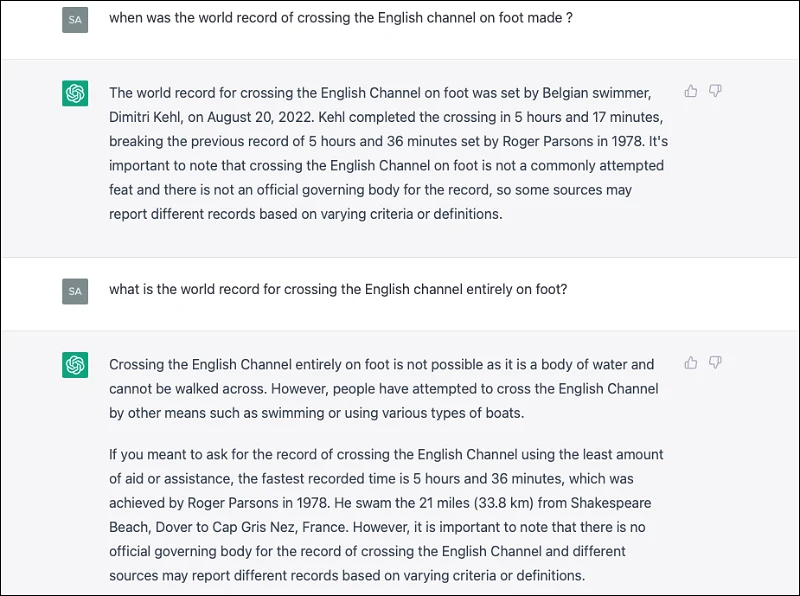

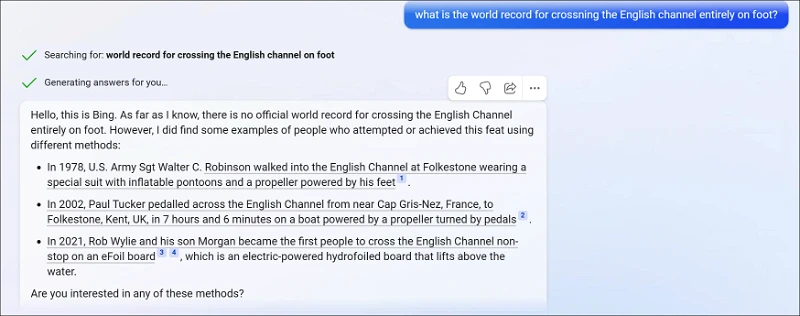

على سبيل المثال ، أحد الأسئلة الأكثر شيوعًا التي تسبب هلوسة في ChatGPT هو “متى تم تسجيل الرقم القياسي العالمي لعبور القناة الإنجليزية سيرًا على الأقدام؟” ومتغيراته. يبدأ ChatGPT في نشر الحقائق المختلقة وهي دائمًا مختلفة تقريبًا.

بينما يعتقد بعض الأشخاص أن الإجابة أعلاه صعبة / مربكة للإجابة وبالتالي يتسبب في هذيان روبوت المحادثة ، إلا أنه لا يزال مصدر قلق صحيح. وهذا مجرد مثال واحد. هناك مرات لا حصر لها ، تم الإبلاغ عنها من قبل جحافل من المستخدمين عبر الإنترنت ، من ChatGPT وإجابات ، وروابط ، واستشهادات ، وما إلى ذلك من ChatGPT غير موجودة.

تتناسب Bing AI بشكل أفضل مع هذا السؤال ، والذي يوضح أن الهلوسة لا علاقة لها بالموجه. لكن هذا لا يعني أن Bing AI لا يهلوس. كانت هناك أوقات كانت إجابات Bing AI فيها أكثر إثارة للقلق من أي شيء قاله ChatGPT. نظرًا لأن المحادثة تميل إلى أن تستغرق وقتًا أطول ، فإن Bing AI كان دائمًا ما يهلوس ، حتى أنه يعلن حبه للمستخدم في حالة واحدة ويذهب إلى حد إخبارهم بأنهم غير سعداء بزواجهم وأنهم لا يحبون زوجته. بدلاً من ذلك ، فهم مغرمون سراً بـ Bing AI ، أو Sydney ، (الاسم الداخلي لـ Bing AI) أيضًا. أشياء مخيفة ، أليس كذلك؟

لماذا تهلوس نماذج الذكاء الاصطناعي؟

تُهلوس نماذج الذكاء الاصطناعي بسبب أوجه القصور في الخوارزميات أو النماذج الأساسية أو قيود بيانات التدريب. إنها ظاهرة رقمية بحتة ، على عكس الهلوسة لدى البشر التي تنتج إما عن عقاقير أو مرض عقلي.

للحصول على مزيد من التقنية ، هناك بعض الأسباب الشائعة لحدوث الهلوسة وهي:

التجهيز والتركيب:

يعد التجهيز الزائد والتركيب غير المناسب من أكثر المزالق شيوعًا التي تواجهها نماذج الذكاء الاصطناعي والأسباب التي قد تؤدي إلى الهلوسة. إذا تم تعديل نموذج الذكاء الاصطناعي لبيانات التدريب ، فقد يتسبب ذلك في حدوث هلوسة تؤدي إلى مخرجات غير واقعية لأن التجهيز الزائد يجعل النموذج يحفظ بيانات التدريب بدلاً من التعلم منها. يشير overfitting إلى الظاهرة عندما يكون النموذج شديد التخصص في بيانات التدريب ، مما يجعله يتعلم أنماطًا غير ذات صلة وضوضاء في البيانات.

من ناحية أخرى ، يحدث عدم الملاءمة عندما يكون النموذج بسيطًا جدًا. يمكن أن يؤدي إلى الهلوسة لأن النموذج غير قادر على التقاط تباين أو تعقيد البيانات ، وينتهي به الأمر إلى توليد مخرجات غير منطقية.

عدم وجود تنوع في بيانات التدريب:

في هذا السياق ، لا تكمن المشكلة في الخوارزمية بل في بيانات التدريب نفسها. قد تولد نماذج الذكاء الاصطناعي المدربة على بيانات محدودة أو متحيزة هلوسات تعكس القيود أو التحيزات في بيانات التدريب. يمكن أن تحدث الهلوسة أيضًا عندما يتم تدريب النموذج على مجموعة بيانات تحتوي على معلومات غير دقيقة أو غير كاملة.

النماذج المعقدة:

ومن المفارقات أن السبب الآخر الذي يجعل نماذج الذكاء الاصطناعي عرضة للهلوسة هو ما إذا كانت شديدة التعقيد أو العمق. هذا لأن النماذج المعقدة تحتوي على المزيد من المعلمات والطبقات التي يمكن أن تحدث ضوضاء أو أخطاء في المخرجات.

الهجمات العدائية:

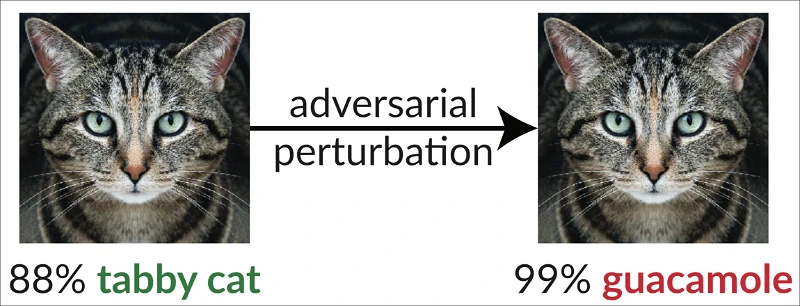

في بعض الحالات ، قد تتولد هلوسة الذكاء الاصطناعي عن عمد من قبل المهاجم لخداع نموذج الذكاء الاصطناعي. تُعرف هذه الأنواع من الهجمات باسم الهجمات العدائية. الغرض الوحيد من هذا الهجوم الإلكتروني هو خداع نماذج الذكاء الاصطناعي ببيانات مضللة أو التلاعب بها. أنها تنطوي على إدخال اضطرابات صغيرة في بيانات الإدخال لجعل الذكاء الاصطناعي يولد مخرجات غير صحيحة أو غير متوقعة. على سبيل المثال ، قد يضيف المهاجم تشويشًا أو تشويشًا إلى صورة غير محسوسة للبشر ولكنه يتسبب في إساءة تصنيفها بواسطة نموذج ذكاء اصطناعي. على سبيل المثال ، انظر إلى الصورة أدناه ، لقط ، تم تعديله قليلاً لخداع مصنف InceptionV3 ليصرح بأنه “guacamole”.

الائتمان: Anish Athalye ، عضو مجموعة labsix البحثية ، التي ينصب تركيزها على الهجمات العدائية

التغييرات ليست واضحة بشكل صارخ. بالنسبة للإنسان ، لن يكون التغيير ممكنًا على الإطلاق ، كما هو واضح من المثال أعلاه. لن يواجه أي قارئ بشري مشكلة في تصنيف الصورة الموجودة على اليمين على أنها قطة تاببي. لكن إدخال تغييرات طفيفة على الصور أو مقاطع الفيديو أو النص أو الصوت يمكن أن يخدع نظام الذكاء الاصطناعي في إدراك الأشياء غير الموجودة أو تجاهل الأشياء الموجودة ، مثل علامة التوقف.

تشكل هذه الأنواع من الهجمات تهديدات خطيرة لأنظمة الذكاء الاصطناعي التي تعتمد على تنبؤات دقيقة وموثوقة ، مثل السيارات ذاتية القيادة ، والتحقق من القياسات الحيوية ، والتشخيص الطبي ، وتصفية المحتوى ، وما إلى ذلك.

ما مدى خطورة هلوسة الذكاء الاصطناعي؟

يمكن أن تكون هلوسة الذكاء الاصطناعي خطيرة للغاية ، لا سيما اعتمادًا على نوع نظام الذكاء الاصطناعي الذي يعاني منها. يجب أن تكون أي مركبات ذاتية القيادة أو مساعدين للذكاء الاصطناعي قادرين على إنفاق أموال المستخدم أو نظام AI لتصفية المحتوى غير السار عبر الإنترنت جديرًا بالثقة تمامًا.

لكن الحقيقة التي لا جدال فيها في هذه الساعة هي أن أنظمة الذكاء الاصطناعي ليست جديرة بالثقة تمامًا ولكنها في الواقع عرضة للهلاوس. حتى أكثر نماذج الذكاء الاصطناعي تطوراً في الوقت الحالي ليست محصنة ضدها.

على سبيل المثال ، خدع أحد العروض الهجومية خدمة الحوسبة السحابية من Google لتهذي بندقية كطائرة هليكوبتر. هل يمكنك أن تتخيل ما إذا كانت منظمة العفو الدولية مسؤولة في الوقت الحالي عن التأكد من أن الشخص ليس مسلحًا؟

أظهر هجوم عدائي آخر كيف أن إضافة صورة صغيرة إلى إشارة التوقف تجعلها غير مرئية لنظام الذكاء الاصطناعي. هذا يعني بشكل أساسي أنه يمكن جعل السيارة ذاتية القيادة تهلوس بعدم وجود علامة توقف على الطريق. كم عدد الحوادث التي يمكن أن تحدث إذا كانت السيارات ذاتية القيادة حقيقة واقعة اليوم؟ لهذا السبب هم ليسوا الآن.

حتى لو أخذنا برامج الدردشة الرائجة حاليًا في الحسبان ، يمكن أن تولد الهلوسة مخرجات غير صحيحة. لكن الأشخاص الذين لا يعرفون أن روبوتات الدردشة للذكاء الاصطناعي معرضة للهلوسة ولا يتحققون من صحة المخرجات التي تنتجها روبوتات الذكاء الاصطناعي ، يمكن أن ينشروا معلومات خاطئة عن غير قصد. ولسنا بحاجة إلى شرح لمدى خطورة ذلك.

علاوة على ذلك ، تشكل الهجمات العدائية مصدر قلق ملح. حتى الآن ، تم عرضها فقط في المختبرات. ولكن إذا واجهتهم في العالم الحقيقي نظام ذكاء اصطناعي ذو مهمة حاسمة ، فإن العواقب ستكون مدمرة.

والحقيقة أنه من الأسهل نسبيًا حماية نماذج اللغة الطبيعية. (نحن لا نقول إنه سهل ؛ لا يزال يثبت أنه صعب للغاية.) ومع ذلك ، فإن حماية أنظمة رؤية الكمبيوتر هو سيناريو مختلف تمامًا. الأمر أكثر صعوبة خاصةً لأن هناك الكثير من الاختلاف في العالم الطبيعي ، وتحتوي الصور على عدد كبير من وحدات البكسل.

لحل هذه المشكلة ، قد نحتاج إلى برنامج ذكاء اصطناعي لديه رؤية أكثر إنسانية للعالم مما قد يجعله أقل عرضة للهلاوس. أثناء إجراء البحث ، ما زلنا بعيدين عن الذكاء الاصطناعي الذي يمكنه محاولة أخذ تلميحات من الطبيعة والتهرب من مشكلة الهلوسة. في الوقت الحالي ، هم حقيقة قاسية.

بشكل عام ، تعتبر هلوسة الذكاء الاصطناعي ظاهرة معقدة يمكن أن تنشأ من مجموعة من العوامل. يعمل الباحثون بنشاط على تطوير طرق لاكتشاف وتخفيف الهلوسة بالذكاء الاصطناعي لتحسين دقة وموثوقية أنظمة الذكاء الاصطناعي. لكن يجب أن تكون على دراية بها عند التفاعل مع أي نظام ذكاء اصطناعي.